OVH数据中心服务中断24小时 液冷:怪我咯?(3)

首先,2003年建造的数据中心,到现在也用了有十几年了,可想而知其基础设施必然不能完全满足最新IT设备的一些要求,比如更高的功率密度。所以,需要对基础设施做一些改造,常用的手段一般是密闭冷热通道,采用近端制冷等,这里OVH选择了技术难度更高的液冷。

其次,从文中描述来看,提供的服务主要是博客评论等WEB服务,似乎不需要很高的功率密度。

这台液冷存储阵列恐怕更多的是技术尝试的性质。这从文中“两套毗邻的存储机架,一套用液冷,一套没用(推测还是空调)”可以看出。

文中也提到了,OVH希望通过新的方案,“能够通过非专用商业阵列配合Ceph与ZFS以摆脱对专用设备的依赖”。

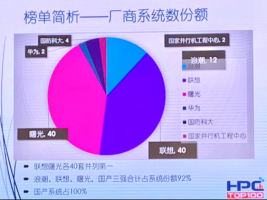

近年来,传统IT厂家和IDC的使用者们的博弈一直存在。从google的定制服务器,到国内互联网公司发起的去“IOE”“天蝎服务器”,甚至基于X86架构的云计算技术,其本质都是用户对“低价”“标准化”“摆脱厂家捆绑”的诉求。

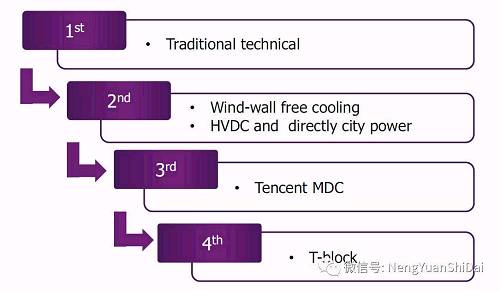

但理想和现实总有差距,也并非每家IDC运营者都有google的技术和苹果的财力。即便是国内BAT的自建数据中心,也是在不断摸索中一代代的逐渐演进。

腾讯IDC技术的四代演进

而托管数据中心的提供商们,大多还是更愿意采用成熟的方案和产品。这里除了技术积累的不足,更多还是出于产品成熟度和用户安全的考虑。毕竟是托管的东西,出了问题不好交代,不像Google这些互联网企业,一会48V、一会内置锂电、一会天蝎,反正是自家的数据中心,折腾坏了也是内部问题。

所以笔者看来,这次OVH确实是有些托大了。

2、冷却液泄露一定会导致服务器故障吗?

液冷技术虽然目前使用的不多,但各IT厂家也陆续推出了一些产品,主要应用于高性能计算、机器学习等各种高密场景。液冷技术方案有多种,不同方案技术特点不同。

不同液冷技术的特点

水冷网www.shuileng.net报道首先,2003年建造的数据中心,到现在也用了有十几年了,可想而知其基础设施必然不能完全满足最新IT设备的一些要求,比如更高的功率密度。所以,需要对基础设施做一些改造,常用的手段一般是密闭冷热通道,采用近端...

延伸 ・ 阅读

- 2018-10-232018开放数据中心峰会开幕 技

- 2018-10-23CDCE2018国际数据中心及云计算

- 2018-10-18数据中心冷战:风冷未央 液冷

- 2018-10-13华为助力客户迈向智能云数据中

- 2018-10-11美利云与上海电力牵手 建设大

- 2018-10-02为数据中心加速 英特尔扩充FPG

评论 ・ 交流

- 全部评论(0)